熊链圣诞活动 Box 脚本,Dolomite 存一次Bera奖励2个 Box,集齐 NFT 圣诞开奖。

Read more

Carry-Coin 架构设计 SymbolLedger (4)

Carry-Coin 套利币本 SymbolLedger 设计,SymbolLedger负责存放套利过程中交易对信息,其中包括symbol在Cex中的各项配置、套利阈值等,Dex中的各种合约信息、阈值、交易参数等

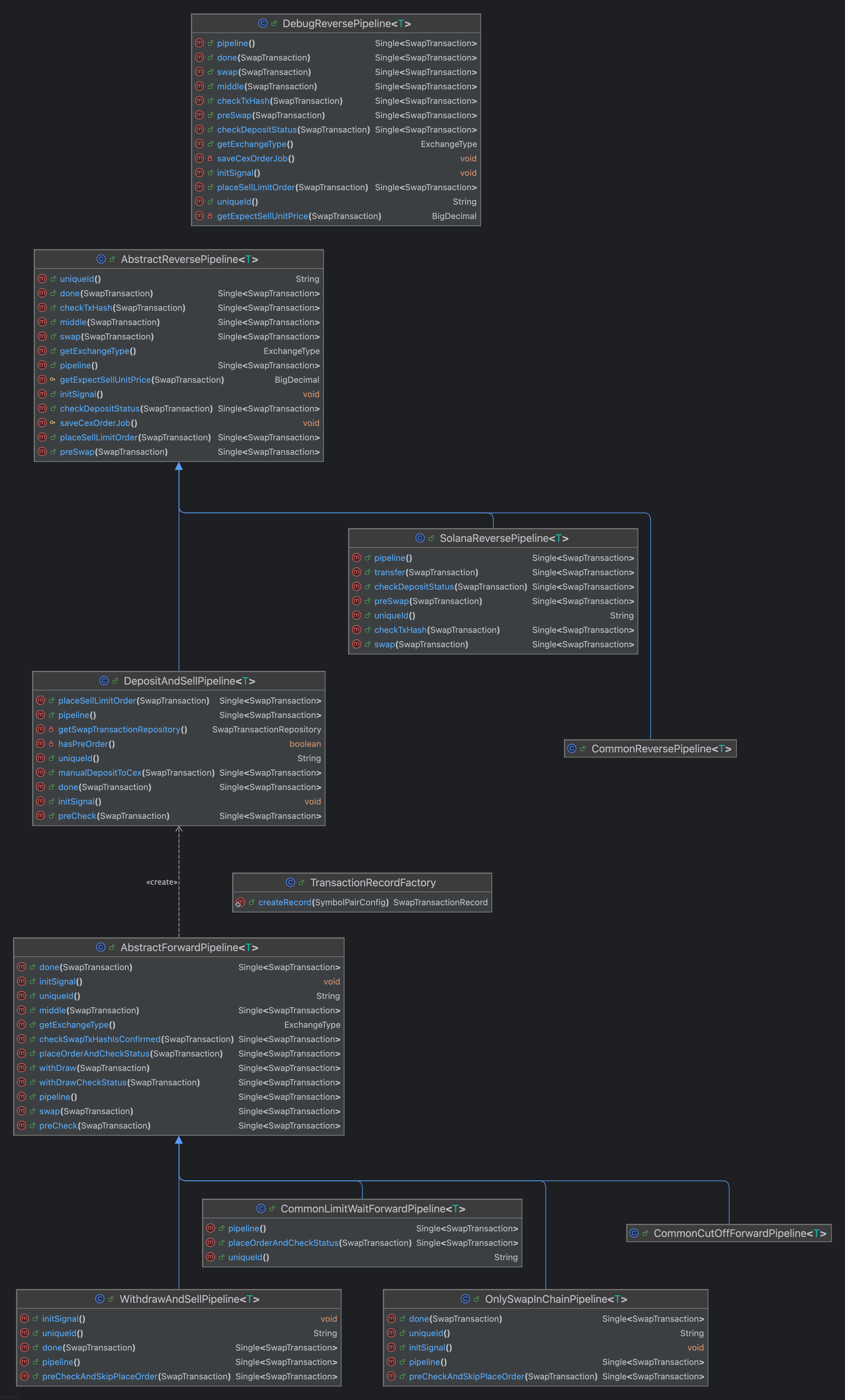

Carry-Coin Core的PipelineAction,Job的设计

Carry-Coin Core的Center,Decenter,protocol的设计

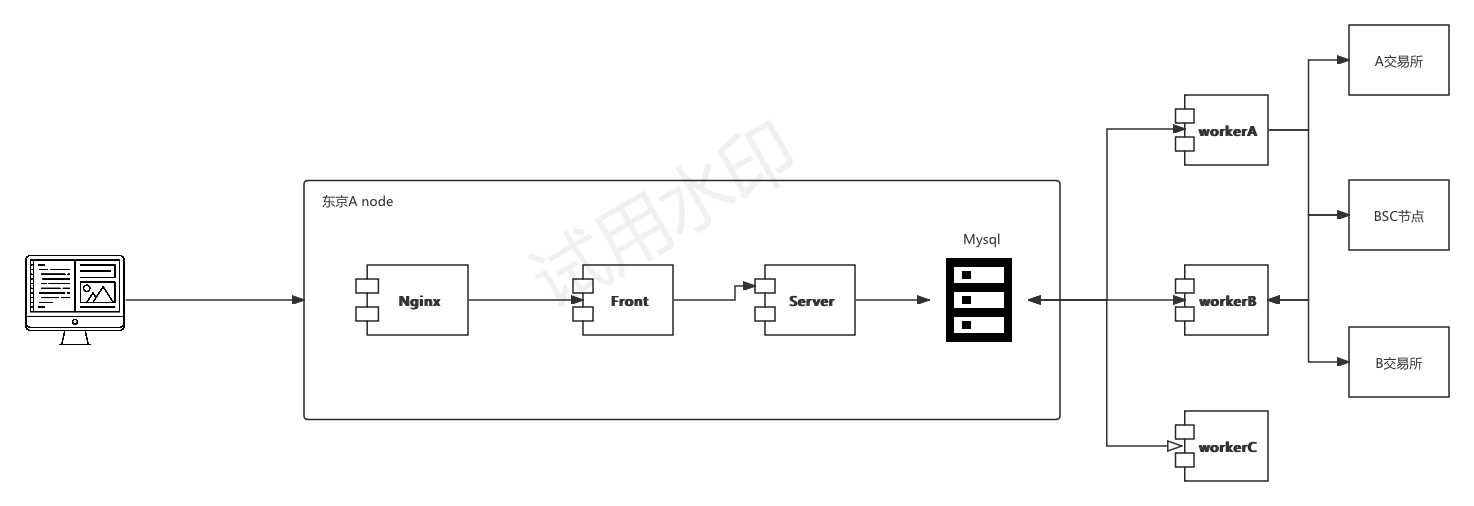

Carry-Coin 是一个套利程序,程序从23年初开始开发至今,目前已经基本稳定,现在将程序的设计整理出来;

套利思路很简单:程序监控Cex和Dex平台,针对同一币种发现差价后自动化搬运;

miniconda安装完后,zsh命令行主题不显示conda的环境name

Install

1 | curl -o Miniconda3-latest-MacOSX-x86_64.sh https://repo.anaconda.com/miniconda/Miniconda3-latest-MacOSX-x86_64.sh |